Viés de Seleção: O Inimigo Oculto nas suas Pesquisas

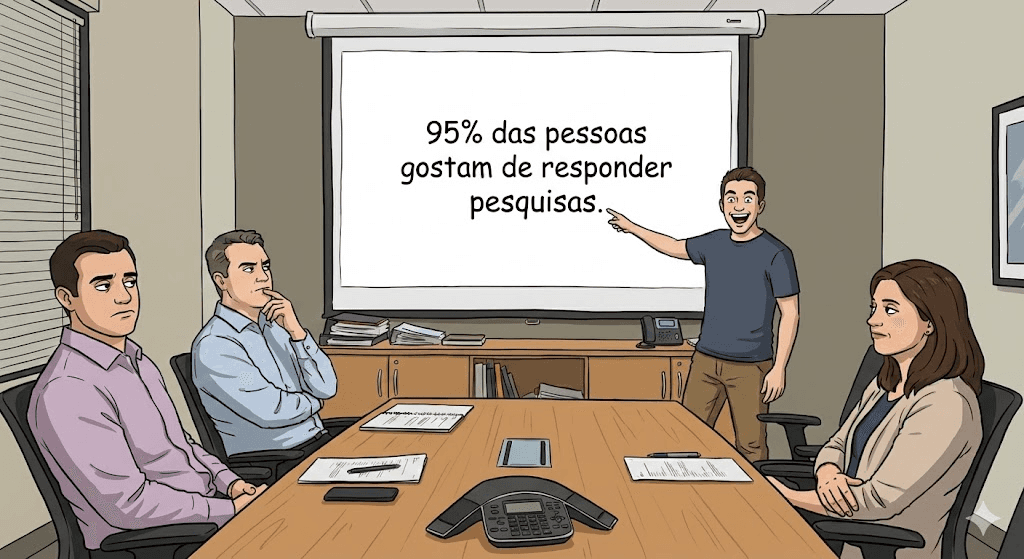

Já viu esse meme?

Ele brinca com a ideia de que quem responderia "não gosto" é justamente quem ignorou a pesquisa. Essa brincadeira ilustra perfeitamente um dos maiores vilões na análise de dados: o Viés de Seleção. Esse é um risco oculto nas não-respostas que pode fazer com que supostas decisões "data-driven" sejam piores do que aquelas tomadas apenas por instinto.

Os Vilões Invisíveis: Tipos de Viés

Vamos explorar alguns casos clássicos.

O cenário dos 95% acima representa o viés da não-resposta, onde a decisão de responder está diretamente ligada à variável que queremos estudar.

Outra situação clássica é o viés do sobrevivente. Próximo do final da Segunda Guerra, militares estudaram onde os aviões que retornavam eram mais atingidos para reforçar a blindagem. Mais tarde, se deram conta de que apenas consideravam os danos "suportáveis". As peças que mais precisavam de reforço eram justamente as vitais, atingidas nos aviões que caíram e não sobreviveram para contar a estória.

No mundo corporativo, o NPS é um paralelo claro. Frequentemente analisamos a satisfação de quem respondeu, esquecendo que o cliente insatisfeito (Detrator) muitas vezes já abandonou a base (Churn) e não "sobreviveu" para responder à pesquisa, criando, assim, uma miragem de satisfação.

Por fim, semelhante ao viés da não-resposta, temos o viés do voluntário. Em pesquisas de satisfação de produtos em e-commerce, a base tende a polarizar. Os consumidores que tiveram uma percepção "ok" tendem a não se interessar em opinar. Isso causa uma falsa polarização, podendo indicar erroneamente que um produto está abaixo do padrão de qualidade por simples coincidência amostral.

De forma geral, o viés de seleção cria um abismo entre os respondentes e a população real. Nas próximas linhas, vamos explorar como a Ciência de Dados nos permite construir pontes sobre esse abismo.

Aprofundamento Prático: Tratando a Diferença

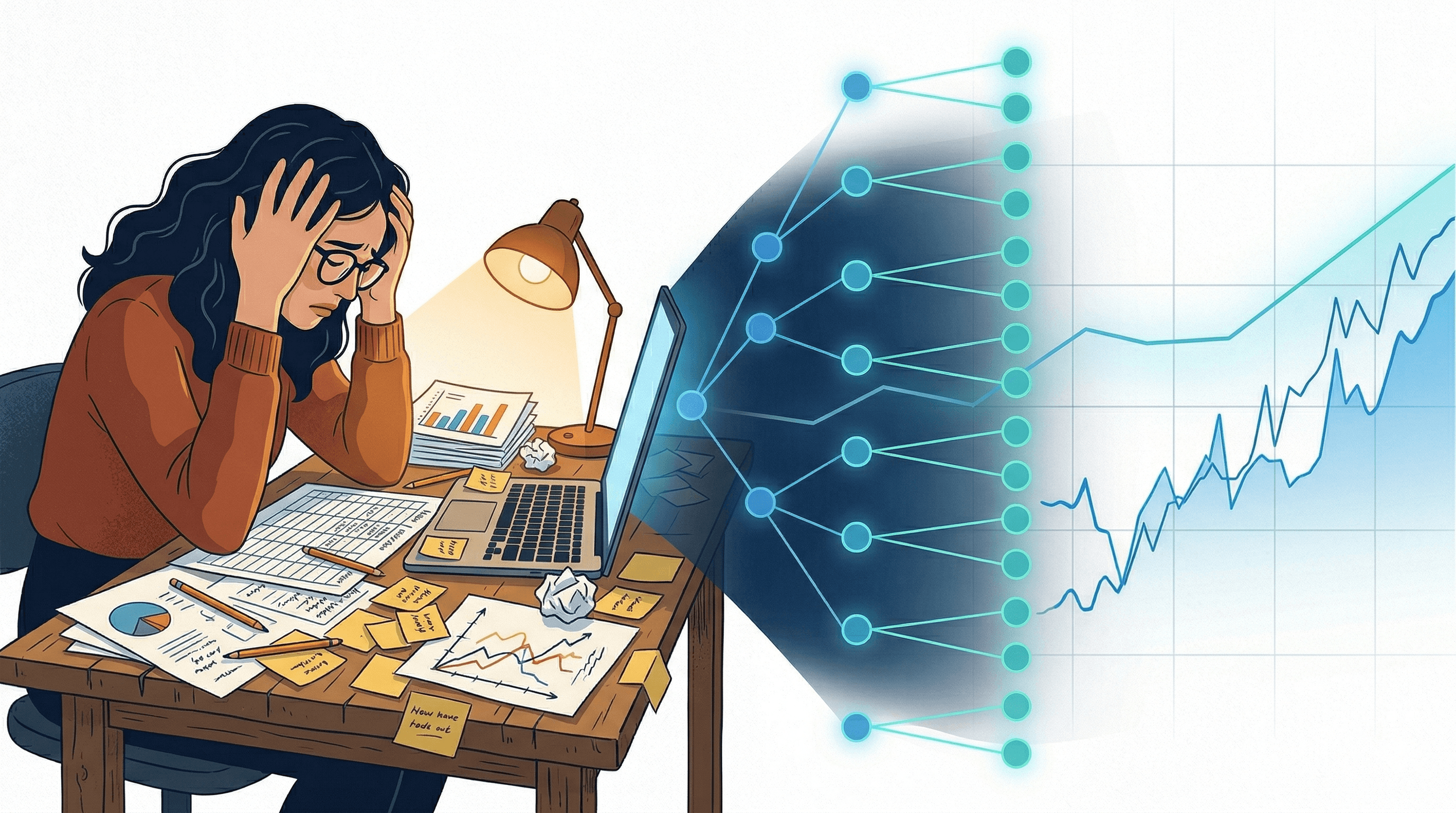

Antes de mais nada, vamos visualizar o viés:

Considere que o gráfico refere-se a qualquer variável de interesse (renda, horas no computador, etc.). O viés da seleção faz com que sua distribuição assuma um perfil completamente diferente da população real. Se você basear sua decisão apenas na curva laranja (respondentes), pode precificar errado seu produto e perder a maior parte do mercado (curva azul).

A solução intuitiva parece simples: "Podemos apenas deformar os dados dos respondentes para se parecerem mais com a população?".

A ideia é exatamente essa. Mas, no mundo real não temos a distribuição da população na variável de interesse, caso contrário não faríamos a pesquisa. Então, o que fazer? Temos algumas abordagens principais:

1. Raking (O Ajuste Demográfico)

O plano é minimizar a diferença nas variáveis que já temos (idade, sexo, bairro), na intenção de minimizar por consequência a diferença nas variáveis de interesse.

Você pega a distribuição dessas variáveis conhecidas e, iterativamente, aumenta ou diminui o peso de cada amostra. O objetivo é fazer com que a demografia da sua pesquisa fique cada vez mais parecida com a da população total. Ao ajustar o peso demográfico, a variável de estudo tende a se corrigir também.

Em Python, a lógica iterativa se parece com isso:

# target_dist: Dicionário com a % real da população (ex: IBGE)

# df: Dataframe da sua pesquisa

variables = ['sexo', 'faixa_etaria', 'regiao']

# O Raking é um processo iterativo até a convergência

for i in range(10):

for var in variables:

# 1. Calcular distribuição atual na amostra (ponderada)

current_dist = df.groupby(var)['weight'].sum() / df['weight'].sum()

# 2. Calcular fator de correção (Meta / Atual)

# Se a meta é 50% mulheres e temos 25%, o fator será 2.0

factors = target_dist[var] / current_dist

# 3. Atualizar pesos das amostras

df['weight'] *= df[var].map(factors)

2. IPW (Inverse Probability Weighting)

Diferente do Raking, o IPW foca na probabilidade.

Treinamos um modelo de Machine Learning para prever se uma pessoa vai ou não responder à pesquisa. O peso atribuído a cada respondente será o inverso dessa probabilidade (1 / probabilidade). Ou seja, damos "um megafone" para o respondente que tinha baixa chance de responder, pois estatisticamente ele representa o grupo silencioso.

A implementação conceitual seria:

from sklearn.linear_model import LogisticRegression

# 1. Treinar modelo para prever a probabilidade de resposta (Propensity Score)

# Usamos dados demográficos que temos de TODOS (respondentes e não respondentes)

model = LogisticRegression()

model.fit(X_demographics, y_responded) # y: 1=Respondeu, 0=Ignorou

# 2. Prever a probabilidade de cada indivíduo ter respondido

probs = model.predict_proba(X_demographics)[:, 1]

# 3. Calcular o peso IPW

# O "Pulo do Gato": Inverter a probabilidade.

# Quem tinha probabilidade baixa (0.1) ganha peso alto (10x)

df['ipw_weight'] = 1.0 / probs

3. Análise de Onda (Wave Analysis)

Mas e se não conhecemos a população total? Análise de onda utiliza o comportamento dos respondentes na própria pesquisa, para apoiar em entender o comportamento de quem nem respondeu. Partindo da premissa de que responder não é um booleano (Sim/Não), mas sim um degradê.

Imagine que enviamos 3 lembretes. A premissa diz que quem respondeu só no terceiro lembrete se assemelha mais a quem não respondeu do que quem respondeu logo de cara. Então, aumentamos o peso dos respondentes tardios para inferir o comportamento dos não-respondentes.

Podemos usar uma regressão simples para extrapolar essa tendência:

from sklearn.linear_model import LinearRegression

# Premissa: O comportamento muda linearmente conforme a "demora" (Onda)

# Onda 1: Resposta Imediata | Onda 2: Lembrete 1 | Onda 3: Lembrete Final

# Treinar regressão: X = Onda, Y = Variável de Interesse (ex: Satisfação)

reg = LinearRegression()

reg.fit(df[['wave_number']], df['satisfaction_score'])

# Extrapolar para a "Onda 4" (O perfil teórico do não-respondente)

non_respondents_score = reg.predict([[4]])

print(f"Estimativa ajustada para o público invisível: {non_respondents_score}")

Validando a Confiança: Análise de Sensibilidade

Mesmo com os ajustes, como garantir a segurança do insight? Recomendo a Análise de Sensibilidade com Ponto de Virada.

Para cada insight, pergunte: "Quão diferente os não-respondentes precisariam ser para que este insight estivesse errado?".

A fórmula abaixo nos ajuda a simular esse cenário, onde Valor é a média da pesquisa e Alteração é o quão pior imaginamos que os não-respondentes sejam:

$$\text{Média Simulada} = (\text{Valor} \times \text{Taxa}) + (\text{Valor} \times (1 - \text{Taxa}) \times (1 + \text{Alteração}))$$

Exemplo 1:

"A nota média de satisfação é 8 (na realidade 8.4 arredondado pra 8)" (com 50% de respondentes).

Simulamos que os não-respondentes têm uma percepção pior:

| Alteração | Média simulada |

| 0% | 8.4 |

| -10% | 8 |

| -20% | 7.6 |

| -25% | 7.4 |

| Nesse caso, a percepção de quem não respondeu precisaria ser 25% pior para derrubar significativamente a média. É uma margem de segurança alta. O insight é robusto. |

Exemplo 2:

"A renda média anual é de 97K" (70% de resposta).

Ao rodar a simulação, percebemos que uma alteração de apenas 2% nos não-respondentes já invalida a afirmação!

Isso é um lembrete de que, em surveys, devemos trabalhar com faixas (ranges). Se no exemplo 2 usássemos a premissa de que a média está "entre 90k e 100k", o valor de alteração necessário para quebrar a afirmação subiria para 26%, sem mudar o sentido do insight e trazendo muito mais confiança. No exemplo 1 já levamos isso em conta de forma discreta, por conta do arredondamento dizer que a nota é 8, diz que ela está entre 7.6 e 8.4.

Conclusão

Como pode ver, a Ciência de Dados apresenta ferramentas não só para analisar o que foi coletado, mas para iluminar o que não foi. Ferramentas como Raking, IPW e Análise de Sensibilidade são essenciais para transformar dados brutos em inteligência estratégica, garantindo que suas decisões de negócio estejam não só embasadas em dados, mas em dados confiáveis.